El sistema operativo móvil iOS 13 también trae una función muy interesante que permite a las aplicaciones capturar diferentes tomas desde diferentes cámaras de un mismo dispositivo, incluido el sonido.

Algo similar ha funcionado en Mac desde los días del sistema operativo OS X Lion. Pero hasta ahora, el rendimiento limitado del hardware móvil no lo ha permitido. Sin embargo, con la última generación de iPhones y iPads, incluso este obstáculo desaparece y, por lo tanto, iOS 13 puede grabar simultáneamente desde varias cámaras en un dispositivo.

Podría ser te interesa

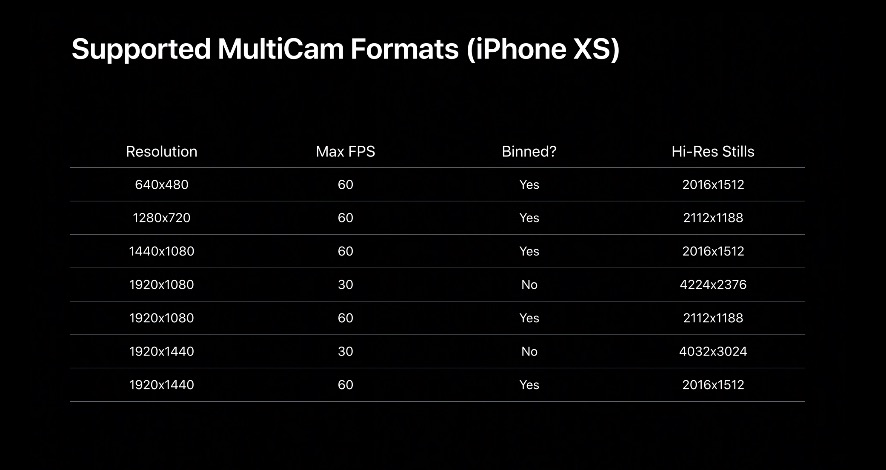

Gracias a la nueva API, los desarrolladores podrán elegir desde qué cámara la aplicación toma qué entrada. Es decir, por ejemplo, la cámara frontal puede grabar vídeo mientras la cámara trasera toma fotografías. Esto también se aplica al sonido.

Parte de la presentación en la WWDC 2019 fue una demostración de cómo una aplicación puede utilizar múltiples registros. La aplicación podrá así grabar al usuario y al mismo tiempo grabar el fondo de la escena con la cámara trasera.

Grabación simultánea de varias cámaras solo en dispositivos nuevos

En la aplicación Fotos, era posible simplemente intercambiar ambos registros durante la reproducción. Además, los desarrolladores tendrán acceso a las cámaras TrueDepth frontales de los nuevos iPhone o al objetivo gran angular o teleobjetivo de la parte trasera.

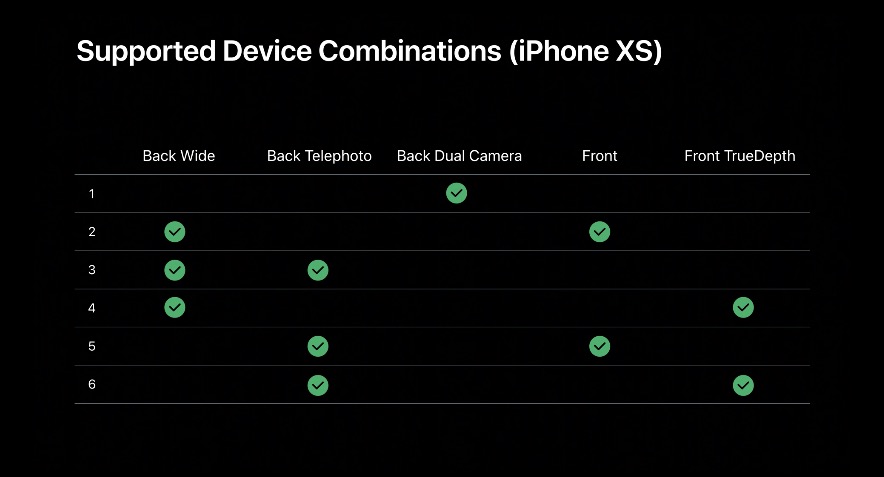

Esto nos lleva a la limitación que tendrá la función. Actualmente, solo se admiten iPhone XS, XS Max, XR y el nuevo iPad Pro. No hay otros dispositivos nuevos característica en iOS 13 todavía no pueden usarlo y probablemente tampoco podrán hacerlo.

Además, Apple ha publicado listas de combinaciones compatibles. Tras un examen más detenido, se puede concluir que algunas restricciones no son tanto de hardware como de software, y Cupertino bloquea deliberadamente el acceso en algunos lugares.

Debido a la capacidad de la batería, los iPhone y iPad solo podrán utilizar un canal de metraje multicámara. Por el contrario, Mac no tiene tal limitación, ni siquiera los MacBook portátiles. Además, la función destacada probablemente ni siquiera formará parte de la aplicación de cámara del sistema.

La fantasía de un desarrollador

Por tanto, el papel principal serán las habilidades de los desarrolladores y su imaginación. Apple ha mostrado una cosa más, y es el reconocimiento semántico de segmentos de imágenes. Bajo este término no se esconde nada más que la capacidad de reconocer una figura en una imagen, su piel, su cabello, sus dientes y sus ojos. Gracias a estas áreas detectadas automáticamente, los desarrolladores pueden asignar diferentes partes del código y, por tanto, funciones.

Podría ser te interesa

En el taller WWDC 2019 se presentó una aplicación que filmaba el fondo (circo, cámara trasera) en paralelo al movimiento del personaje (usuario, cámara frontal) y podía establecer el color de la piel como un payaso usando regiones semánticas. .

Por lo tanto, solo podemos esperar cómo los desarrolladores adoptan la nueva función.

Fuente: 9to5Mac