Apple presentó el iPhone X en 2017 y modificó por primera vez el recorte de la cámara TrueDepth el año pasado con el iPhone 13. Ahora se espera que veamos su eliminación el 7 de septiembre, al menos en los modelos de iPhone 14 Pro (Max). . Pero, ¿cómo le va a la competencia de los teléfonos Android en este sentido?

Para diferenciar más la serie básica de la serie profesional, y debido a los costes, Apple utilizará el rediseño del agujero sólo para las versiones más caras. Por lo tanto, el iPhone 14 mantendrá el recorte que mostró el año pasado el iPhone 13. Para los modelos, por otro lado, cambiarán a la llamada solución de orificio pasante, aunque podemos discutir mucho sobre esta designación. aquí, porque definitivamente no será un agujero pasante.

Inicialmente se especuló que el sistema de la cámara frontal y sus sensores tendría la forma de una suave "i" en orientación horizontal, es decir, que el típico agujero se complementaría con un óvalo con sensores. Ahora han surgido informes de que el espacio entre estos elementos tendrá píxeles desactivados en la pantalla para que la forma general sea más consistente. En la final, es posible que veamos un surco negro más largo. Además, debería mostrar señales para el uso del micrófono y la cámara, es decir, puntos naranjas y verdes, que ahora se muestran a la derecha junto al recorte en orientación vertical.

Podría ser te interesa

Es una verificación biométrica

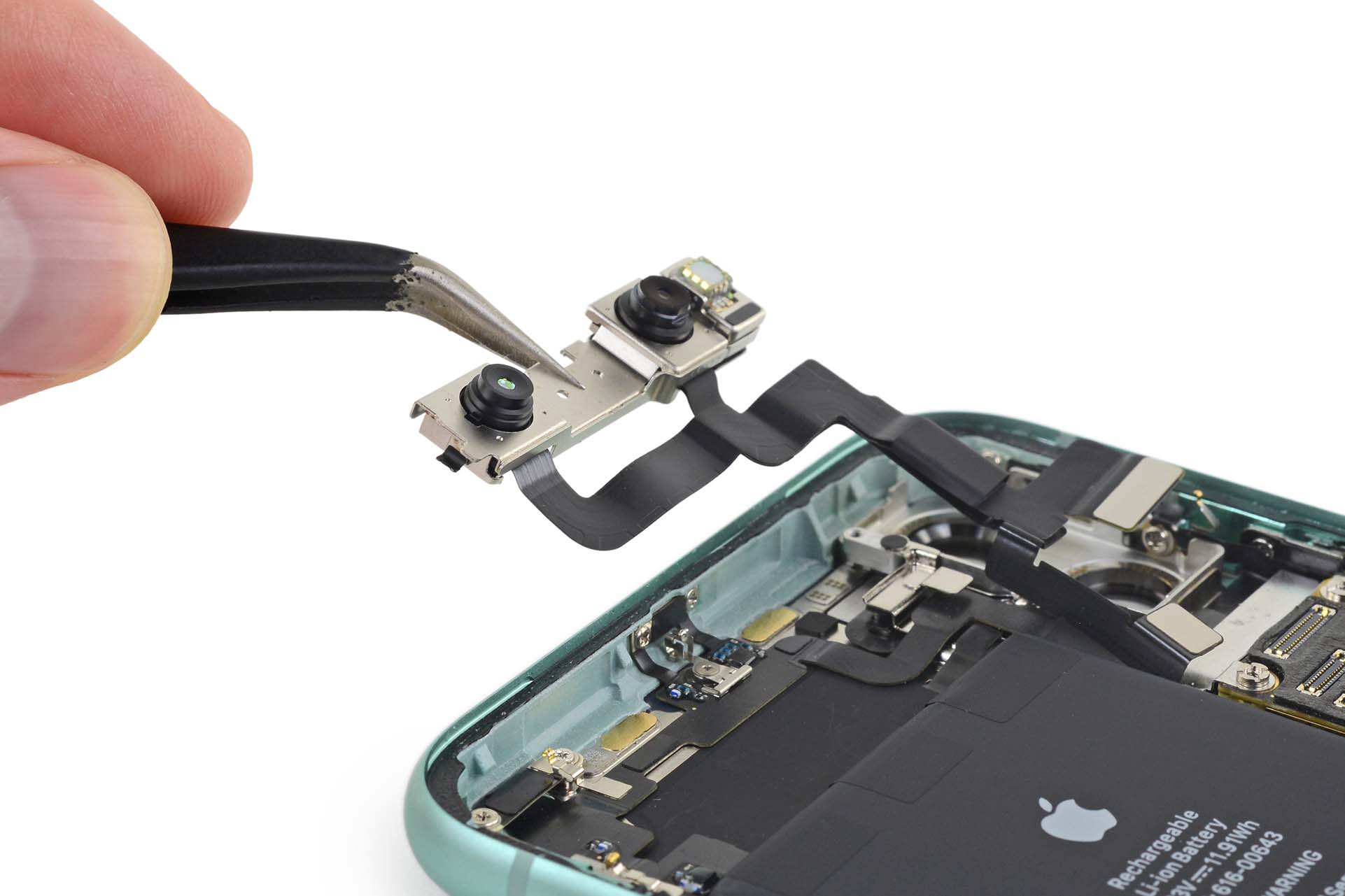

Cuando Apple lanzó el iPhone X, muchos fabricantes empezaron a copiar su apariencia y la función en sí, es decir, la autenticación del usuario mediante escaneo facial. Aunque aquí todavía lo ofrecen, no es verificación biométrica. En la gran mayoría de los teléfonos normales, la cámara frontal no va acompañada de ningún sensor (hay uno, pero normalmente sólo para regular el brillo de la pantalla, etc.) y, por tanto, sólo escanea la cara. Y esa es la diferencia. Este escaneo facial no es necesario para una autenticación biométrica completa y, por lo tanto, es suficiente para acceder al teléfono, pero normalmente no para aplicaciones de pago.

Los fabricantes se echaron atrás porque la tecnología era cara y, en su caso, no completamente perfecta. Esto les dio la ventaja de que prácticamente les basta con colocar la cámara para selfies en un típico orificio redondo o en un corte en forma de gota, porque alrededor de la cámara no hay nada excepto el altavoz, entre el cual esconden con bastante habilidad. la pantalla y el marco superior del chasis (aquí Apple se está poniendo al día). El resultado, por supuesto, es que ofrecerán un área de visualización más grande, porque seamos sinceros, el espacio alrededor del recorte del iPhone es simplemente inutilizable.

Podría ser te interesa

Pero como también necesitan proporcionar al usuario una autenticación biométrica adecuada, todavía dependen de lectores de huellas dactilares. Pasaron de la parte posterior del dispositivo no solo al botón de encendido, sino también debajo de la pantalla. Por lo tanto, los lectores ultrasónicos y otros lectores sensoriales ofrecen verificación biométrica, pero su confiabilidad también está sujeta a muchas conjeturas. Incluso con ellos, si sufres problemas en la piel o tienes las manos sucias o mojadas, sigues sin poder desbloquear el teléfono ni comprar ese hot dog en el quiosco de la plaza (por supuesto, existe la opción de introducir un código) .

En este sentido, FaceID es mucho más fiable y agradable de usar. Te reconoce incluso si te crece el pelo o la barba, si usas gafas o incluso si tienes una mascarilla sobre las vías respiratorias. Al rediseñar el recorte, Apple dará un paso relativamente grande, donde logrará minimizar al máximo su tecnología, que sigue siendo original y utilizable después de cinco años, para que no haya necesidad de buscar alternativas. Seguramente en el futuro los propios sensores quedarán ocultos bajo la pantalla, como ocurre ahora con las cámaras frontales de los teléfonos, especialmente de los fabricantes chinos (y los Galaxy Z Fold3 y 4 de Samsung), aunque la calidad de salida sigue siendo discutible.

adam kos

adam kos