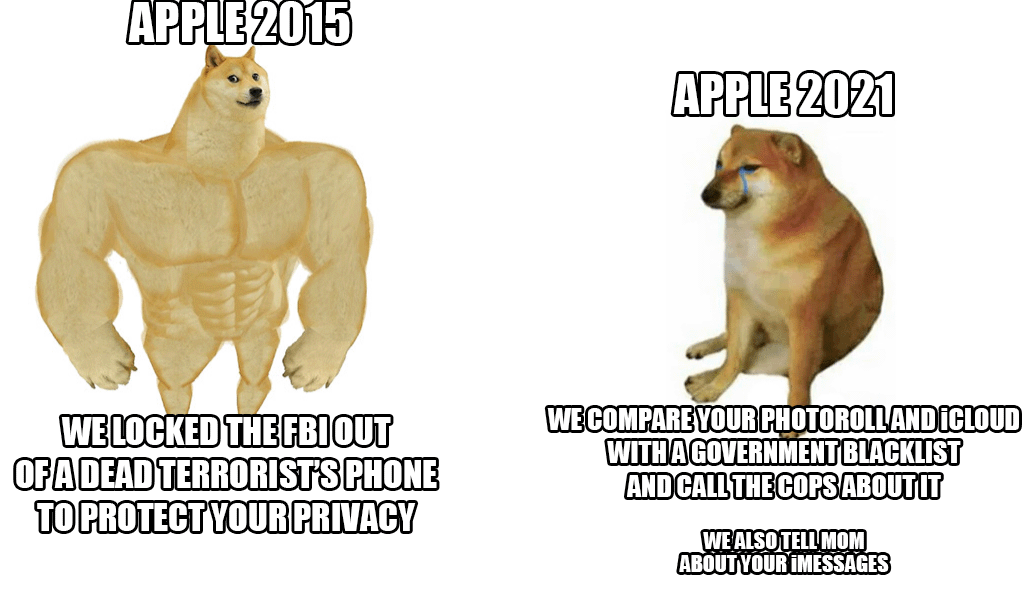

A fines de la semana pasada, Apple presentó un nuevo sistema contra el abuso infantil que escaneará prácticamente todas las fotos de iCloud. Aunque la idea suena bien a primera vista, ya que los niños realmente necesitan estar protegidos de esta acción, el gigante de Cupertino recibió una avalancha de críticas, no sólo por parte de los usuarios y expertos en seguridad, sino también de los propios empleados.

Según la información más reciente de una agencia respetada. Reuters Varios empleados expresaron sus preocupaciones sobre este sistema en una comunicación interna en Slack. Supuestamente deberían temer posibles abusos por parte de las autoridades y los gobiernos, que podrían aprovechar estas posibilidades, por ejemplo, para censurar a personas o grupos seleccionados. La revelación del sistema desató un fuerte debate, que ya cuenta con más de 800 mensajes individuales dentro del mencionado Slack. En resumen, los empleados están preocupados. Incluso los expertos en seguridad ya han llamado la atención sobre el hecho de que en las manos equivocadas sería un arma realmente peligrosa para reprimir a los activistas, su mencionada censura y cosas similares.

La buena noticia (hasta ahora) es que la novedad recién comenzará en Estados Unidos. Por el momento ni siquiera está claro si el sistema también se utilizará dentro de los países de la Unión Europea. Sin embargo, a pesar de todas las críticas, Apple se mantiene firme y defiende el sistema. Sostiene, sobre todo, que todas las comprobaciones se realizan dentro del dispositivo y, una vez que hay una coincidencia, sólo en ese momento un empleado de Apple vuelve a comprobar el caso. Sólo a su discreción será entregado a las autoridades pertinentes.

Podría ser te interesa

Odiaría cambiar de iCloud a algo seguro y verdaderamente privado, pero si Apple insiste, dejaré de pagarles de todos modos.

Estará activo (por ahora) sólo en EE.UU.

Realmente no importa dónde se aplicará legislativamente. Esa tecnología ya estará disponible y desplegada. Ese es el mayor riesgo.