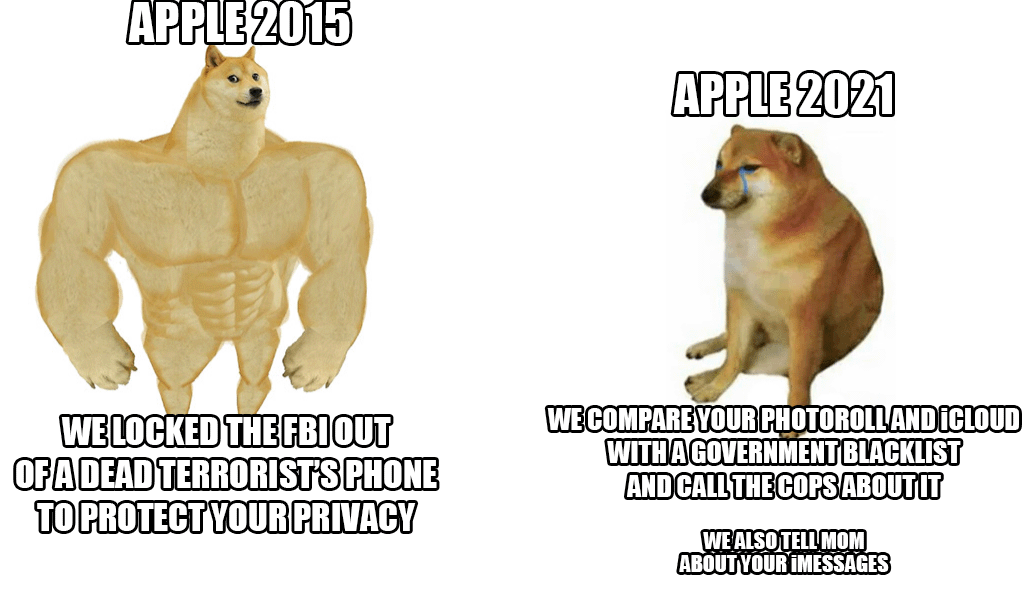

A finales de la semana pasada os informamos de una novedad bastante interesante: un nuevo sistema para detectar imágenes que representan abuso infantil. En concreto, Apple escaneará todas las fotos almacenadas en iCloud y, en caso de detección, informará de estos casos a las autoridades pertinentes. Aunque el sistema funciona "de forma segura" dentro del dispositivo, el gigante fue criticado por violar la privacidad, como también lo anunció el popular denunciante Edward Snowden.

Podría ser te interesa

El problema es que Apple hasta ahora ha confiado en la privacidad de sus usuarios, que quiere proteger en todas las circunstancias. Pero esta noticia trastoca directamente su actitud original. Los productores de manzanas se enfrentan literalmente a un hecho consumado y tienen que elegir entre dos opciones. O tendrán un sistema especial que escanea todas las imágenes almacenadas en iCloud o dejarán de usar fotos de iCloud. Entonces todo funcionará de forma muy sencilla. El iPhone descargará una base de datos de hashes y luego los comparará con las fotos. Al mismo tiempo, también intervendrá en las noticias, donde se supone que debe proteger a los niños e informar oportunamente a los padres sobre comportamientos riesgosos. Entonces surge la preocupación de que alguien pueda abusar de la propia base de datos o, peor aún, de que el sistema no sólo escanee fotos, sino también mensajes y toda la actividad, por ejemplo.

Por supuesto, Apple tuvo que responder a las críticas lo más rápido posible. Por eso, por ejemplo, publicó un documento de preguntas frecuentes y ahora confirmó que el sistema solo escaneará fotos, pero no vídeos. También lo describen como una versión más respetuosa con la privacidad que la que utilizan otros gigantes tecnológicos. Al mismo tiempo, la compañía de la manzana describió con mayor precisión cómo funcionaría todo esto. Si hay una coincidencia al comparar la base de datos con las imágenes en iCloud, se crea un comprobante criptográficamente seguro por ese hecho.

Como ya se mencionó anteriormente, el sistema también será relativamente fácil de eludir, lo cual fue confirmado directamente por Apple. En ese caso, simplemente deshabilite Fotos en iCloud, lo que facilita omitir el proceso de verificación. Pero surge una pregunta. ¿Vale la pena? En cualquier caso, la buena noticia sigue siendo que el sistema se está implementando sólo en los Estados Unidos de América, al menos por ahora. ¿Cómo ve este sistema? ¿Estaría usted a favor de su introducción en los países de la Unión Europea o es una intrusión demasiado grande en la privacidad?

Bueno, es complicado. Por supuesto, la protección de la privacidad está casi por encima de todo lo demás. También es una de las razones por las que uso esta plataforma. Pero todo tiene sus límites. En resumen, toda libertad termina cuando infringe la libertad de otra persona. Está claro que se deben tomar medidas contra alguien que esté dispuesto a dañar o abusar de los niños. Eso es indiscutible.

Como ya se mencionó anteriormente, el sistema también será relativamente fácil de eludir, lo cual fue confirmado directamente por Apple. En ese caso, simplemente deshabilite Fotos en iCloud, lo que facilita omitir el proceso de verificación.

Porque al mismo tiempo significa apagar el álbum compartido. Que sencillo querido Watson :)

Hurgar automáticamente en fotografías sin la autorización de la autoridad designada es un error en principio, y apuesto a que este es sólo el primer paso. Hay tantas cosas que se pueden hacer que al principio son justificables y luego ya no se pueden detener. Pornografía infantil-> comercio de carnes blancas-> crueldad hacia los animales -> no prestar atención al conducir -> participación en los eventos de oposición fiestas...

El problema es qué hace posible este proceso. ¿Por qué el fabricante del teléfono y del sistema operativo tiene que decirnos qué incluir como usuario? Por supuesto, es muy agradable escuchar especialmente a los niños adecuados, por lo que Apple incluso patrocina un dispositivo de última generación que se ocupa de este problema. ¿Por qué las organizaciones sin fines de lucro lo resuelven, porque a los niños no les interesa el Estado? Realmente no me molesta si no estoy haciendo nada malo, pero convierten a todos los usuarios de iPhone/iPad en delincuentes potenciales. Esto es una lógica retorcida, yo diría que una de las soluciones más simples, escanearemos tus fotos de forma segura. Entonces, todos los que me envían pornografía infantil a través de iMessage están frustrados porque soy un criminal y seré responsable ante una empresa privada por algo que no me interesa y, mientras tanto, no iniciaré sesión porque mi identificación será bloqueada. Y todas las personas frustradas que son tan estúpidas que comparten las fotos de sus hijos y las guardan en la nube, se irán a otra parte porque las personas más estúpidas quedan atrapadas en esto. Además de un par de padres que accidentalmente tomaron una foto de sus hijos con un pindik/pipinka. Bien jugado.

¿Por qué atraparían a los padres que tomaron una fotografía de sus hijos desnudos? No funciona de esa manera

Sí, lo escribí mal, por lo que probablemente no funcione. Y además ?